Section 6.5 Somme de puissances et nombres de Takazaku

Depuis le début même des mathématiques proprement dites, des mathématiciens se sont attaqués à la question suivante: y a-t-il une formule générale pour les sommes de puissances d'entiers

Et quand je dis depuis le début, je veux dire le début du début:

C'est (peut-être) Pythagore et ses élèves, vers -500, qui ont trouvé, les premiers, un formule pour la valeur des \(S_1(n)\text{,}\) qu'ils appelaient les "nombres triangulaires", en arrangeant des cailloux sur une planche:

A partir de cette formule et en jouant avec des cubes, Archimède, 200 ans et 400 km plus loin, trouva une formule pour les sommes de nombres au carré \(S_2(n)\) (du moins, c'est ce qu'on pense, il ne l'a pas écrite proprement):

Comment \(S_2(n)\) a (peut-être) été obtenu (Ici le rôle d'Archimède est joué par mon ancien cobureau, l'estimé professeur Olivier Pierre)

L'avancée suivante, la somme des nombres au cube \(S_3(n)\text{,}\) nous emmène loin puisqu'elle fut obtenue par le mathématicien indien Aryabhata vers 476 et (probablement) aussi par Abu Bakr al-Karaji vers 1019, avec un astucieux découpage de rectangles:

Une décennie après, Abu Ali al-Hassan ibn al Haytham (ou, comme on dit pas chez nous "Ab...Al..Abual...Alhazen") obtient la somme des puissance 4, mais pas en insérant des jetons ronds dans une grille verticale comme on aurait pu le croire.

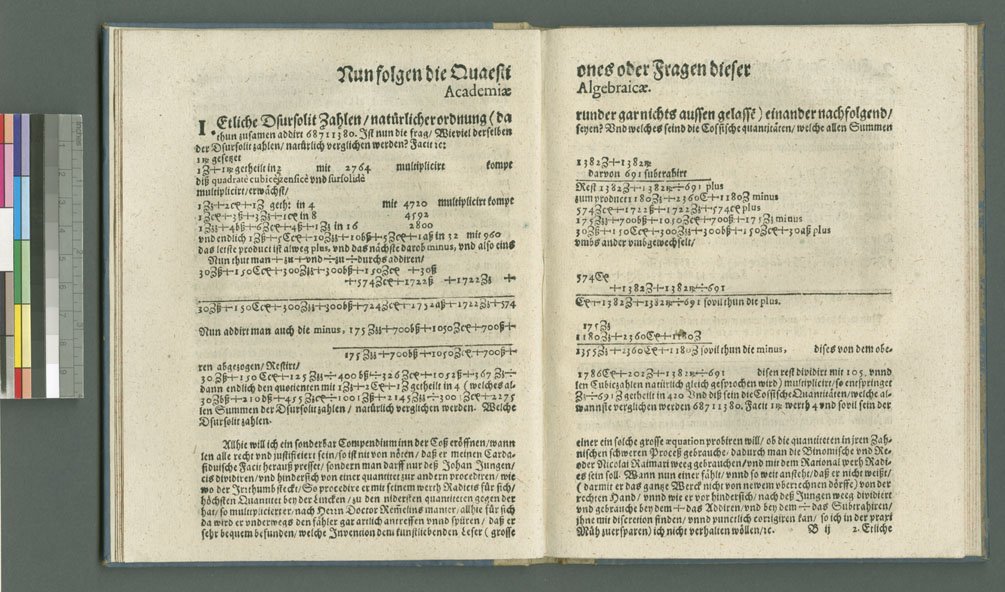

De là dans l'Europe du XVIIème, Harriot, Fermat et Pascal s'attaquèrent au problème, avec des formules de généralisation par récurrence tordues et relativement impraticable. Il semble qu'ils n'étaient pas au courant des travaux de Faulhaber, un algébriste allemand pourtant assez reconnu, qui calcula les sommes de puissances jusqu'à 17 (peut-être même 23). Certains disent que c'est son éducation au sein d'une famille de tisserands qui le prédisposent à voir, dans des colonnes de nombres, des motifs réguliers et alternés.

Il disait avoir une formule générale pour \(S_d(n)\text{,}\) qu'il ne donna hélas pas, mais d'un autre côté il disait aussi pouvoir transformer le plomb en or et prédire l'avenir via des relations numérologiques dans la Bible. Donc bon.

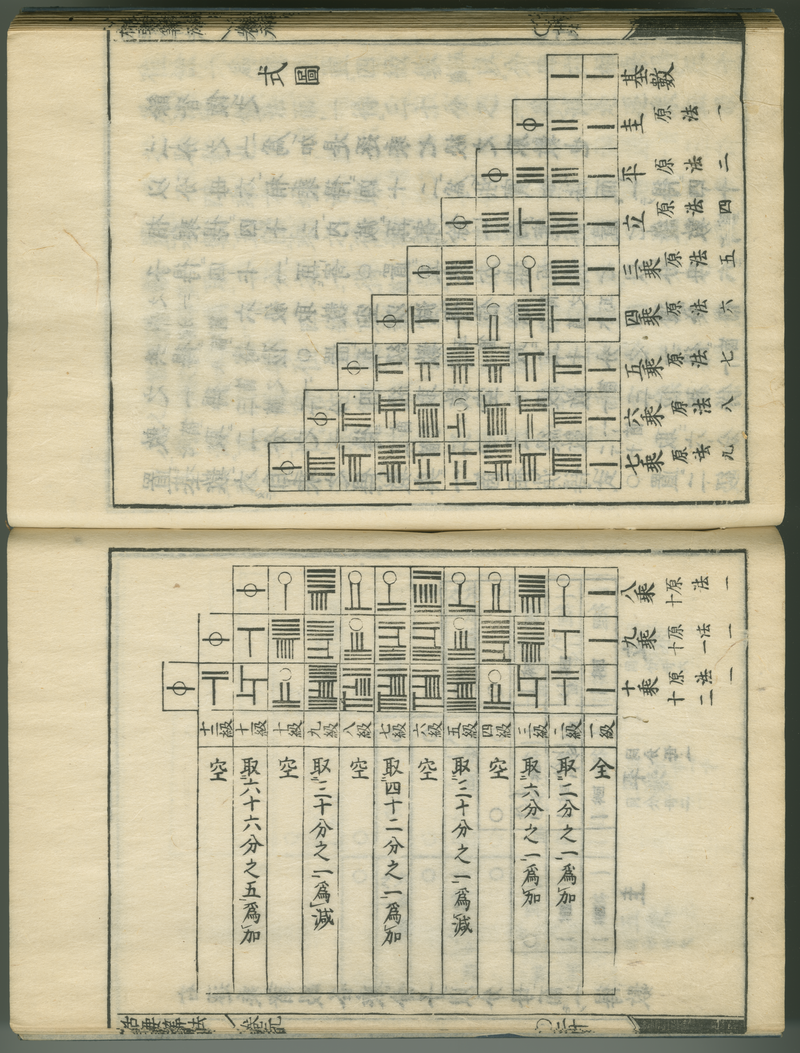

Encore moins connu en Europe, Takazaku Seki (関 孝和, ça claque plus), héritier d'une famille de samourai, abandonna ses fonctions bureaucratiques sous le shogunat pour se consacrer aux mathématiques. Il fut le premier à étudier les déterminants (avant Leibniz), le première à découvrir la méthode de Newton pour la résolution d'équations (avant Newton), et le premier à découvrir les nombres de Bernoulli (cavant Bernoulli), mais qui reste virtuellement inconnu par ici. Il y a quand même un astéroïde de 18km qui porte son nom, 7483 Sekitakakazu, et au Japon il était parfois gratifié du titre de 賛生 Sansei, "sage des mathématiques", par analogie avec Bashō "Haisei", le maître des haiku. Ses étudiants fondèrent une école en son nom, 関流 Seki-ryū, qui continua longtemps de dominer les mathématiques japonaises .

Parallèlement à Takazaku, Jakob Bernoulli reprit les calculs de Fermat sur les 10 premières sommes, à la recherche de régularités. Regardons avec lui les six premières:

Une observation assez immédiate, c'est que le premier coefficient de \(S_d(n)\) semble jusqu'ici être toujours \(\frac1{d+1}\text{,}\) et ensuite de nouveaux nombres apparaissent en initiant de nouvelles "colonnes": \(\frac12,\frac16,\frac1{30},\frac1{42}...\text{,}\) apparemment quelque peu au pif. Commençons par mettre ce \(\frac1{d+1}\) en facteur, pour voir:

Maintenant, regardons la deuxième colonne. Avant factorisation, il n'y avait que des \(-\frac12\) dedans, du coup maintenant, il y a...des multiples de \(\frac12\text{.}\) Ecrivons la deuxième colonne factorisée sous ce format:

Encouragés par cette approche, continuons sur la même idée. Le premier coefficient de la troisième colonne qui apparaît est \(\frac16\text{,}\) et la troisième colonne factorisée s'écrit comme multiples de \(\frac16\text{:}\)

Continuons avec la 4ème colonne: elle apparaît pour la première fois avec un coefficient \(\frac1{30}\text{,}\) on met donc joyeusement des \(\frac1{30}\) en facteur du côté factorisé:

Et enfin, sur la 5ème colonne:

Remarquons aussi que chacune des sommes \(S_d(n)\) est un polynôme de degré \(d+1\text{,}\) avec certaines puissances "manquantes" : pas de terme en \(n\) dans \(S_3(n)\text{,}\) pas de terme en \(n^2\) dans \(S_4(n)\text{,}\) pas de terme en \(n^3\) dans \(S_5(n)\text{,}\) ni de terme en \(n\text{,}\) et devinez quoi, pas de termes en \(n^4\) et \(n^2\) dans \(S_6(n)\text{.}\)

Ecrivons les coefficients qu'on a obtenus dans chaque colonne après factorisation par \(\frac12,\frac16,etc.\text{,}\) et en indiquant les puissances manquantes par un "\(\cdot\)":

...Ca ressemble à un triangle de Pascal (en travers duquel un samurai aurait donné un coup de daikatana):

Et donc, puisque les coefficients de la \(n\)-ième ligne du triangle de Pascal sont les coefficients binomiaux \(\binom{n}{k}\text{,}\) les sommes de puissances semblent, en tout cas jusqu'ici, s'écrire quelque chose comme

C'est très joli, à part la mystérieuse suite

On va donc lui donner un nom: on va les appeler des nombres de Bernoulli et les noter \(B_n\) 1 , ce qui nous donne

et surtout, la formule générale des \(S_d(n)\text{,}\) qu'on appelle formule de Falhauber:

ou, comme l'écrivait Jakob, Summae Potestatum:

Là-dessus, Jakob note que tout ceci est très intéressant, puis part faire autre chose (probablement écrire une lettre à Leibniz).

C'est Leonhard Euler qui reprit son travail, et étudia à fond les nombres de Jakob dont il avait besoin pour calculer les valeurs paire de la fonction zeta (dont on reparlera) et pour développer une importante formule de sommation, la formule d'Euler-McLaurin, dont on reparlera aussi.

Voyons quelques propriétés des \((B_n)_n\) que Leonhard a explorées.

Exercice 6.5.1. Etape 1: Une formule par récurrence.

(a)

On va commencer par trouver une formule de récurrence pour les \((B_n)_n\text{.}\)

Montrer que, pour tout \(d\in\N\text{,}\)

(b)

En déduire que, pour tout \(m\in\N^*\text{,}\)

et vérifier à partir de \(B_0=1\) que ça nous redonne bien les \(B_k\) qu'on a trouvés jusqu'ici.

(c)

En déduire \(S_7(n)\) et \(S_8(n)\text{.}\) \(S_9(n)\) si on est motivé !

En profiter pour se sentir supérieur à Fermat et Pascal.

Exercice 6.5.2. Etape 2: Une fonction génératrice.

On commence à le percevoir avec Abel: parfois, pour étudier une suite ou une série, le recours aux fonctions simplifie les choses.

C'est dans cet ordre d'idée que, pour une suite de réels \((a_n)_n\text{,}\) on définit sa fonction génératrice (exponentielle) par

Par exemple, si \((a_n)\) est constante égale à 1, sa fonction génératrice est \(\exp(x)\text{.}\)

Et dans ce cas, pour les \(x\in\R\) tels que la série \(G_{(a_n)_n}(x)\text{,}\) converge absolument, la formule de Taylor nous dit que, pour tout \(k\text{,}\)

\(\leadsto\) On va déterminer la fonction génératrice de \((B_n)_n\text{.}\)

(a)

Posons \(\beta(x)=\sum_{k\geq0} \frac{B_k}{k!}x^k\text{.}\) Pour trouver \(\beta\text{,}\) on va chercher une fonction \(\alpha(x)\) telle que \(\alpha(x)\beta(x)\) donne quelque chose de calculable.

Posons \(\alpha(x)=\sum_{k\geq 0}a_k x^k\text{.}\) Trouver \(C_n\) tel que

(b)

Trouver pour chaque \(n\) et pour chaque \(k=0,...,n\text{,}\) le \(a_{n-k}\) qui permet d'obtenir

En déduire la suite \((a_k)_k\) correspondante.

(c)

Montrer que, avec la suite \((a_k)_k\) ainsi obtenue,

Rappelons maintenant que, pour tout \(x\in\R\text{,}\)

donc

et là, il y a des bouts qui commencent à ressembler à \(a_k x^k\text{.}\)

(d)

D'un autre côté, revenons à

avec, on a dit, \(C_n=\frac1{(n+1)!}\sum_{k=0}^n\binom{n+1}{k}B_k\text{.}\)

Montrer que

(e)

En mettant tout ça ensemble, montrer que

Remarque: Tout ceci ne marche que si la fonction \(\beta\) existe, autrement dit si la somme infinie

tradiconverge. C'est en fait le cas: on peut le montrer en trouvant une estimation de \(B_n\) quand \(n\) tend vers l'infini, mais ce n'est pas de la tarte, et on va admettre que pour \(x\) dans un intervalle \(\rbb -r,r\lbb\) suffisamment resserré, tout se passe bien.

(f)

Remarquer que \(\beta(0)\text{,}\) qui est censé donner \(B_0\text{,}\) n'est en fait pas défini.

Calculer \(\beta'(x)\) et \(\beta''(x)\) et constater qu'elles ne sont pas non plus définies en 0.

Se demander quel est l'intérêt de cette fonction génératrice défectueuse.

(g)

Pas de découragement, c'est là que ça va aider de pouvoir écrire les fonctions comme des "polynômes"

Ici, on s'intéresse aux valeurs de \(\beta(x),\beta'(x),...\) quand \(x\) se rapproche de 0. Or, quand \(x\) se rapproche de 0, \(x^2\) devient beaucoup plus petit que \(x\text{,}\) et \(x^3\) beaucoup plus petit encore, et \(x^{56}\text{,}\) en comparaison, rase le plancher:

Mais du coup, dans notre écriture de, mettons, exponentielle, en polynôme infini

lorsque \(x\) est proche de 0, les premiers termes "pèsent" beaucoup plus dans la somme que les suivants.

Du coup, on peut approximer \(e^x\) en ne gardant que, mettons, les \(4\) premiers termes, et en "ignorant" tous les autres: pour les ignorer sans oublier qu'ils existent, on les met dans un "reste" (un "petit o") qui indique juste "ils sont tout petits par rapport à \(x^4\)":

Concrètement, \(o(x^4)\) désigne n'importe quelle fonction \(zigouigoui(x)\) qui, si on la trace sur le graphique ci-dessus, s'écrase plus vite que \(x^4\) quand \(x\) se rapproche de 0.

Par exemple, au-dessus, on peut voir que \(x^{56}\) est un "petit o de \(x^4\)".

\(\leadsto\) Ce qui permet de passer d'une écriture (exacte) de \(\exp\) sous forme de polynôme infini à une écriture (approximative) de \(\exp\) sous forme de polynôme fini, plus maniable.

En utilisant notre approximation de \(\exp(x)\text{,}\) montrer que, pour \(x\) proche de 0,

En déduire qu'il existe une fonction \(chouia(x)\) telle que

et \(chouïa(x)\xrightarrow[x\rightarrow0]{}0\text{.}\)

(h)

En appliquant notre raisonnement approximatif à une autre formule de développement en polynôme infini qu'on a croisée souvent, on trouve, dans le même genre, qu'il existe une fonction \(plancton(y)\) telle que, pour \(y\in \rbb -1,1\lbb\text{,}\)

et \(plancton(y)\xrightarrow[y\rightarrow0]{}0\text{.}\)

En déduire que

(i)

Une autre propriété de ces approximations (pour un degré donné, ici 4), c'est que pour chaque fonction, il y en a un seul qui marche.

Or pour \(\beta(x)\text{,}\) on en a déjà un:

En comparant les deux polynômes qu'on a obtenus, montrer que

(j)

Bon, mais ça, on le savait déjà.

Pour avoir plus de \(B_n\text{,}\) il faudrait choisir de meilleures approximations de \(e^{-x}\) et \(\frac1{1-y}\text{,}\) mais les calculs deviennent rapidement déplaisants.

On peut toujours demander à plus bête que soi (un logiciel de calcul formel en ligne 3 , mettons) qui nous dit docilement

Quels nombres de Bernoulli peut-on en tirer ?

Au terme de ces quelques calculs, on commence à avoir furieusement l'impression que les nomres de Bernoulli impairs sont en fait tous nuls, à l'exception de \(B_{1}\text{.}\)

Notre fonction génératrice va nous le confirmer:

Exercice 6.5.3. Nullité des nombres de Bernoulli impairs.

(a)

L'observation qui va tout faire marcher, c'est qu'un polynôme ne peut être pair que si tous ses coefficients impairs sont nuls.

Autrement dit, si un polynôme \(P(x)=a_0+a_1x+...+a_nx^n\) vérifie, pour tout \(x\in\R\text{,}\) \(P(x)=P(-x)\text{,}\) alors forcément \(a_1=0,a_3=0,...\text{.}\)

Montrez-le !

(b)

Il se trouve que c'est aussi le cas des polynômes infinis, ou, pour leur donner leur nom officiel, des séries entières: si

est paire, alors en fait forcément tous les coefficients impairs \(a_{2n+1}\) sont nuls.

Montrez-le !

(c)

Equipés de ces nouvelles connaissances, on s'aperçoit que, ce qu'on veut montrer, c'est que les coefficients impairs du polynôme infini

sont tous nuls, sauf le premier. A cause de \(B_1,\) donc, il ne va pas nous suffire de montrer que \(\beta\) est paire (heureusement, car ce n'est pas le cas !)

Modifiez un peu \(\beta\) pour trouver une fonction \(g\) qui, si on montre qu'elle est paire, nous dira que les \(B_{2k+1}\text{,}\) pour \(k\geq 1\text{,}\) sont bien tous nuls.

(d)

Montrer que, pour tout \(x\text{,}\)

(e)

En déduire que \(g\) est paire, et conclure.

Et ce ne sont là que quelques unes des merveilleuses propriétés des nombres de Bernoulli. Historiquement, si Euler s'y intéressait, c'est parce qu'ils permettent d'étudier une certaine fonction, notée \(\zeta(x)\text{,}\) qui va aussi beaucoup nous intéresser dans la suite.

Spoiler.C'est en fait la fonction \(\zeta\) qui nous donnera finalement ce fameux \(-\frac{1}{12}\) !

Une fois devenu un grand maître en nombres de Bernoulli 4 , Euler les utilisa de nouveau pour obtenir une formule de sommation, la formule d'Euler-MacLaurin, qu'on recroisera en compagnie de Ramanujan.

www.desmos.com/calculator/deyjwl1nxzwww.codabrainy.com/taylor/